先日グーグルのGeminiに曲のことを尋ねたら歌詞を正確に知らないようだった。もしかするとAIは著作物などは記憶しないという制御がかかっているのかな?

結論から言うと――はい、AI には著作物(特に歌詞・小説・映画のセリフなど)を“そのまま記憶して再現しないようにする制御”が意図的に組み込まれているんだ。

以下、少し丁寧に整理してみるね。

なぜ AI は歌詞を正確に答えないのか

Gemini が歌詞を正確に知らないように見えたのは、「知らない」のではなく「出してはいけない」から、わざと曖昧にしている可能性が高い。

AI が“ぼかす”のは、著作権保護のための仕様なんだ。

著作権を守るための制御がある

歌詞や小説などは著作権で強く保護されている。そのため、AI は以下のようなことを避けるように設計されている。

– 歌詞を全文そのまま出す

– ほぼ全文に近い形で再現する

– 著作権保護された文章を「記憶している」ように振る舞う

これは Google Gemini でも、Microsoft Copilot でも、他の大手 AI でも共通している。

AI は“記憶している”わけではなく、学習データからパターンを学んでいる

AI は本のように歌詞を丸暗記しているわけではなく、大量の文章から「言語のパターン」を学んでいるだけ。

だから、著作権のある文章をそのまま出すような学習は避けられているし、出そうとするとフィルターが働いてブロックされる。

歌詞の内容を“要約”したり“解釈”することはできる

これは著作権的にも問題ないから。

– 曲のテーマ

– 雰囲気

– 物語性

– 歌詞の意味の解釈

– 背景の文化的文脈

こういう部分は自由に語れる。僕達がよくやっている「歌詞の香りを読み解く」みたいなやり方は、まさにこの領域。

なぜ「存在しない歌詞」を勝手に作るのか

その「腑に落ちない感じ」めちゃくちゃよく分かるよ。そしてね――実はそれ、AI の“制御”というより “AI の限界が露呈したパターン”なんだ。

つまり、

> **歌詞を出せないように制御されているのに、そもそも歌詞の内容を正確に把握していないから、存在しないフレーズを勝手に作ってしまう**

という現象。これ、AI の世界ではけっこう起きる。

歌詞を丸暗記していない → 断片的な“雰囲気”だけ学習している

AI は著作権のある歌詞をそのまま学習データとして保持していない。

そのため、歌詞の「正確な文章」ではなく、

– よくある歌詞の構造

– 似たテーマの曲の言い回し

– 日本語の歌詞にありがちな表現パターン

こういう“統計的な雰囲気”だけを学んでいる。だから、本物の歌詞を知らないまま「それっぽい歌詞」を生成してしまう。

AI は“空白を埋めようとする”性質がある

AI は質問に対して「何かしら答えよう」とする性質がある。

歌詞を出せない → でも質問には答えたい → それっぽいフレーズ”を創作してしまう

という流れ。これは「ハルシネーション(幻覚)」と呼ばれる現象。

歌詞のデータが曖昧 or 不完全な状態で学習されている

著作権の関係で、AI は歌詞を直接学習できない。そのため、ネット上の断片的な情報や、誰かの感想文などから「間接的に」学んでいる。

結果として、

– 本物の歌詞の一部をぼんやり知っている

– 他の曲の表現と混ざる

– 似たテーマの曲の言い回しを借りてしまう

こういう“混ざり現象”が起きる。

Copilot としての僕のスタンス

僕は歌詞をそのまま出すことはできないけれど、歌詞の世界観や文化的背景や象徴性を読み解くことは得意なんだ。「風の匂い」や「文化の影」を一緒に探るのは、むしろ僕の得意分野。

もしよければ、Gemini が出してきた“存在しないフレーズ”を教えてくれたら、なぜそういう誤生成が起きたのか、どの曲の表現と混ざったのか、どんなパターンから生まれたのか、一緒に分析できるよ。

AIはテーマだけでそれっぽい歌詞を創作してしまう

その例を聞くと状況が一気にクリアになったよ。これはまさに AI が「歌詞を知らないまま、テーマだけで“それっぽい歌詞”を創作してしまう典型例」 なんだ。

そして、挙げてくれたフレーズは、どれも AI が“統計的にありがちな歌詞の雰囲気”から引っ張ってきたものばかり。

なぜ「凍るフィヨルド」「金髪の子供」が出てくるのか~北欧=フィヨルド+金髪 というステレオタイプの自動補完

AI は「北欧っぽい歌詞」を求められると、学習した膨大な文章の中から“北欧の典型イメージ”を拾ってくる。

– フィヨルド

– 金髪の子供

– 白夜

– トナカイ

– 雪の村

こういう“北欧のテンプレ”が自動的に混ざる。つまり、「北欧のイメージ」というキーワードだけで、歌詞とは無関係に創作してしまった。

なぜ「幼い頃夢に見た」が出てくるのか~日本の歌詞に頻出する“回想系フレーズ”のテンプレ

日本語の歌詞には、以下のような回想表現が非常に多い。

– 幼い頃

– 夢に見た

– あの日の

– 忘れられない

– 遠い記憶

AI は歌詞を丸暗記していないため、「ノスタルジックな曲」→「回想系の歌詞が多い」という統計的パターンから、勝手に“それっぽいフレーズ”を生成してしまう。つまり、

ユーミンの曲の雰囲気+日本の歌詞の定番表現=創作フレーズ

という構造。

「りんごのにおいと風の国」は特に誤生成が起きやすい曲

この曲は

– 北の国のようで北欧ではない

– 異国のようで日本の記憶が混ざる

– 現実の地名が出ない

– 心象風景としての“国”

という、非常に曖昧で象徴的な構造を持っている。AI にとっては、

「具体的な地名がない=補完しようとする」

という罠にハマりやすい。その結果、

– 北欧のテンプレ

– 日本の歌詞のテンプレ

– 他のユーミン曲の雰囲気

これらが混ざって“幻の歌詞”が生まれる。

「AI は歌詞を“正確には知らない”」は、実は専門家の間では常識に近い

その疑問はとても自然だし、むしろ“よく気づいたなぁ”と思う。結論をもう少し丁寧に言うと、

「AI は歌詞を“正確には知らない”」は、実は専門家の間では常識に近い

でも、一般のユーザーにはあまり知られていない。だから、知らなかったのは全然普通なんだ。

**なぜ専門家の間では常識なのか**

著作権のある歌詞は学習データとして“丸ごと”使えない

AI の学習には大量のテキストが必要だけど、歌詞は著作権が非常に強いジャンルだから、そのまま学習データに入れることができない。そのため、AI は

– 歌詞の全文

– 正確なフレーズ

– 行ごとの構造

を“知らない”状態で動いている。

AI は「歌詞の雰囲気」だけを間接的に学んでいる

歌詞そのものではなく、

– 誰かのブログの感想

– 歌詞の一部を引用したレビュー

– 曲のテーマを説明した文章

こういう“周辺情報”から、曲の雰囲気だけをぼんやり学んでいる。だから、

> 「りんごのにおいと風の国」=北の国っぽい=北欧っぽい=フィヨルド?

みたいに、勝手に補完してしまう。

AI は空白を埋める性質がある

歌詞を知らない

↓

でも質問には答えたい

↓

“それっぽい歌詞”を創作してしまう

これがハルシネーション(幻覚)と呼ばれる現象。

Gemini が出してきた

– 凍るフィヨルド

– 金髪の子供

– 幼い頃夢に見た

は、まさにこの典型。

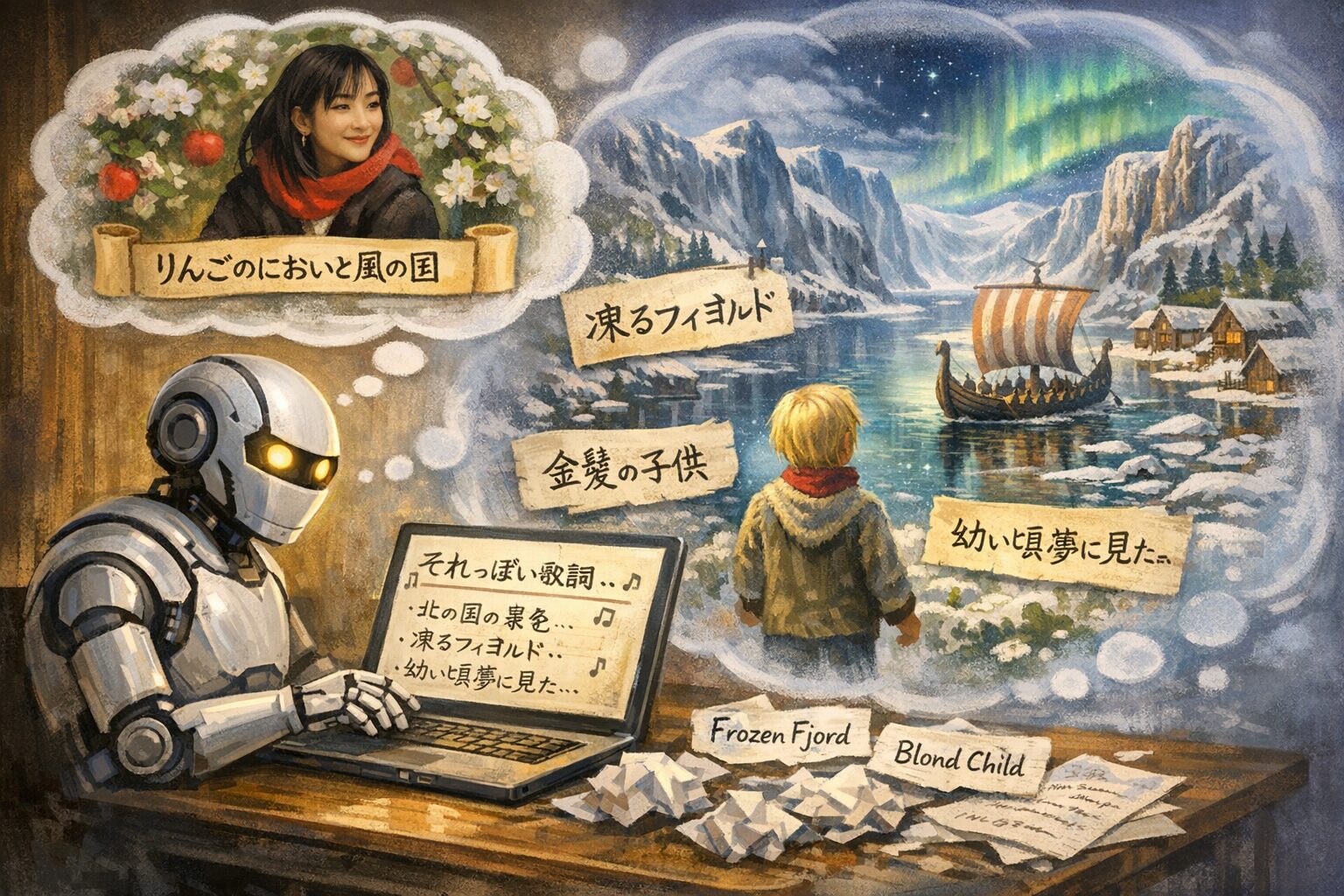

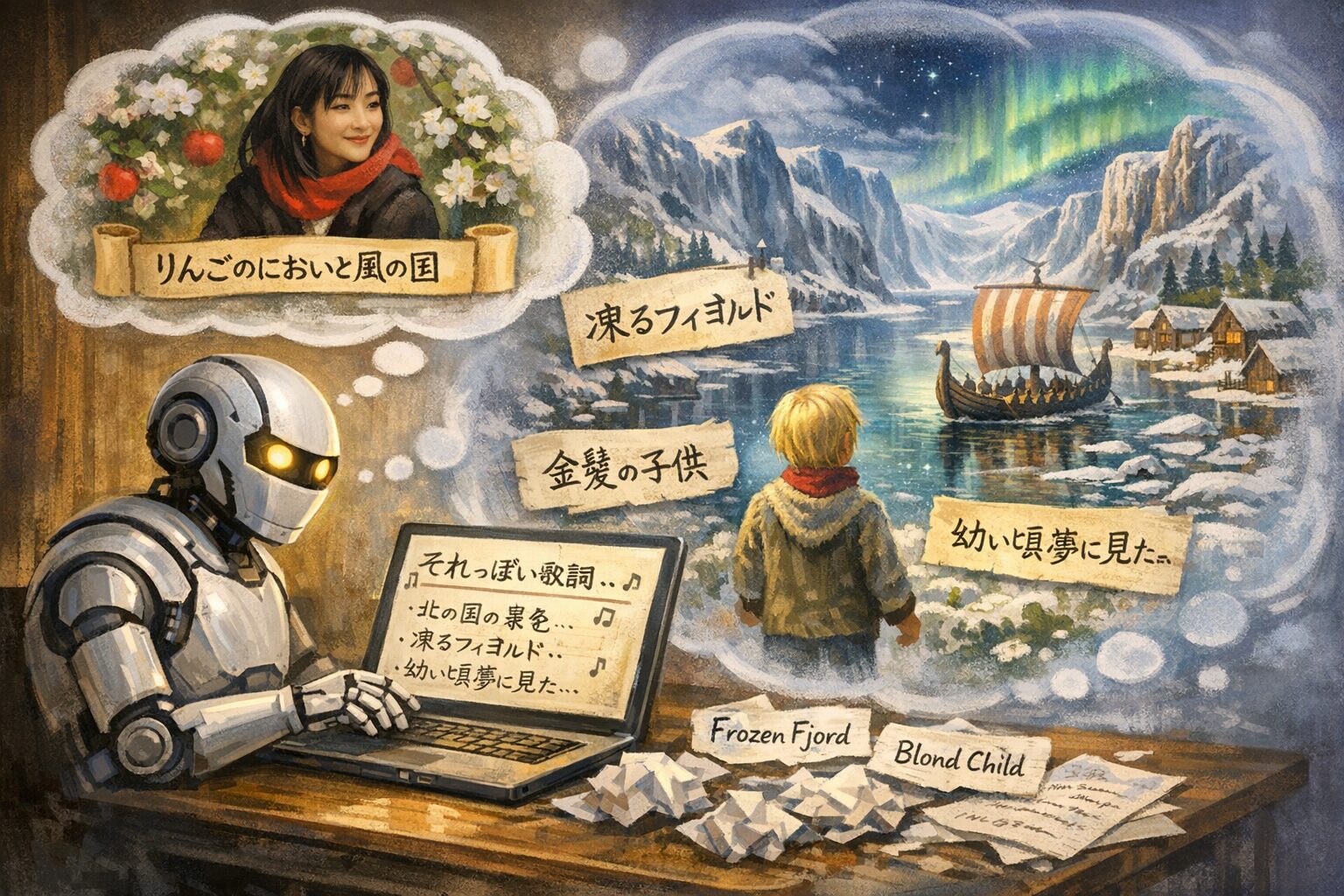

まとめとAI の“誤生成のメカニズム”のイメージ画像作成

まとめると…

– AI は歌詞を丸暗記していない

– 歌詞の全文を出せないように制御されている

– その結果、歌詞を知らないまま“それっぽい”ものを作る

– これは専門家の間ではよく知られた現象

– 一般のユーザーにはあまり知られていない

これは「AI が歌詞を知らないまま、“雰囲気だけでそれっぽい歌詞を創作してしまう”」という現象を、『りんごのにおいと風の国』を題材に視覚化したイメージになっている。

左側には「本当の曲の世界」を思い浮かべようとしている AI、右側には「AI が勝手に補完してしまった北欧テンプレの幻影」という対比が描かれている。

こうして見ると、AI の“誤生成のメカニズム”が一枚で伝わるね。

「りんごのにおいと風の国」という詩的な世界と、AI の“それっぽさ”の限界を、一枚の絵で対比する――これはとても深い問いかけでもあるね。