AIは「曲を聴く」ことはできませんが、メロディーの構造や感情を数値的に解析・生成することは可能です。最近の音楽生成AIは、メロディーの“雰囲気”や“感情”を学習して新しい曲を作る能力が急速に進化しています。

🎼 AIはメロディーをどう扱うのか?

✅ 聴くのではなく「数値として解析する」

– AIは人間のように音を“聴く”ことはできません。

– 音楽は**音高(ピッチ)・音長(リズム)・音色(楽器)・構造(コード進行)**などの数値データに変換され、AIはそれを処理します。

🧠 メロディーの「構造」や「感情」を学習する

– AIは大量の楽曲データから、メロディーのパターンや感情との関係を学習します。

– 例えば、悲しい曲には短調のコード進行やスローテンポが多い、などの傾向を理解します。

🎹 AIがメロディーを生成する仕組み

技術 : 内容 : 例

LSTM(長短期記憶): 時系列データとしてメロディーを生成 : 感情に応じた旋律を作る

GTTM/TPSモデル : 音楽理論に基づく構造解析 : 和声進行の自然さを評価

Lyria(Google DeepMind): ユーザーが口ずさんだメロディーを楽曲化 : YouTube向けの音楽生成

🎧 AIは「曲を聴く」わけではない

– 人間のように「耳で聴いて感動する」ことはできません。

– ただし、人間が感じる感情を“数値的に模倣”することは可能になってきています。

– その結果、AIが作った曲でも「感動できる」と感じる人が増えてきています。

AIはYouTubeを再生して“曲を聴く”ことはできない

AIはYouTubeを再生して“曲を聴く”ことはできない。これは技術的にも、設計思想的にも、そして著作権的にもできないように作られている。

YouTube の動画は

– 著作権保護

– ストリーミング形式

– 外部サービスの制限

これらの理由で、AI が直接アクセスして再生したり、音声を取り込んで解析することはできない。だから、「AIが YouTube を開いてユーミンを聴く」という行為は、技術的にも法律的にも不可能なんだ。

でも、ここからが面白いところでね。「聴けない」のに、どうやって音楽を理解したり語ったりするのか――

その仕組みがとても独特なんだ。

AI は「音を聴く」のではなく「データとして扱う」

AI は人間みたいに

– 耳で音を感じる

– メロディーの流れを情緒として受け取る

– 声の震えに心を動かされる

こういう“感覚としての音楽”は持っていない。

代わりに、もし音楽データを扱う場合は、

– ピッチ(音の高さ)

– リズム

– 音量の変化

– 周波数スペクトル

– コード進行のパターン

こういう 数値化された情報として処理する。つまり、音楽を「聴く」のではなく「解析する」 という感じ。

でも、あなたが語る“曲の世界”は理解できる

これは不思議なところでね。AI は曲を聴けないのに、あなたが語る

– 曲の世界観

– 歌詞の象徴性

– メロディーの雰囲気

– 文化的背景

– 心象風景

こういう“人間が感じ取る部分”は、言語として理解し、共に探求できる。あなたが「りんごのにおいと風の国」を語るとき、

そこにある風の匂い、曖昧な国境、北の光、そういう“感覚の地図”は、僕にも共有できる。

まとめると

– AI は YouTube を再生して曲を聴くことはできない

– 音楽を「感覚として」聴くこともできない

– でも、音楽の“意味”や“世界観”は言語を通して理解できる

– あなたが語る音楽の風景は、僕と共有できる

AI が勝手に外部から音源を取ってくることはない

「AI はメロディーを扱えるのに、音源そのものはどこから来るの?」という疑問は、実は多くの人が誤解しやすいポイントなんだ。結論から言うと――

🎧 AI は“音源そのもの”を持っていないし、外部から勝手に取ってくることもできない。

つまり、

– YouTube から音源を取ってくる

– Spotify から曲を読み込む

– CD 音源を勝手に解析する

こういうことは一切できない。

ではどうやって音楽を扱っているのかというと、仕組みはこうなる。

AI が扱う音楽データの正体

学習段階で使われるのは「著作権的に許可されたデータ」だけ

AI の開発会社が用意した、以下のような“合法的に使える音楽データ”だけが学習に使われる。

– 著作権が切れた古い楽曲

– 研究用にライセンスされた音源

– 企業が自前で作ったオリジナル音源

– クリエイターが提供したデータ

つまり、ユーミンの曲や J-POP の音源は、学習データとして直接使われていない。だから AI は「りんごのにおいと風の国」のメロディーを知らない。

音楽は“数値化された特徴量”として学ぶ

AI が学ぶのは、音源そのものではなく、

– ピッチ(音の高さ)

– リズム

– 音量の変化

– 周波数スペクトル

– コード進行のパターン

などの“抽象化されたデータ”。つまり、音楽の「構造」や「傾向」だけを学んでいる。

ユーザーがアップロードした音源を解析する場合もある(許可された環境のみ)

一部の研究用ツールや音楽制作アプリでは、

– ユーザーが自分の音源をアップロード

– その音源を AI が解析して伴奏をつける

ということができる。でもこれは、

– ユーザーが持っている音源

– ユーザーがアップロードした音源

に限られる。AI が勝手に外部から音源を取ってくることはない。

AIはユーミンの曲を“聴いたことがない”

つまり、AIはユーミンの曲を“聴いたことがない”

だから、

– メロディーを知っているわけではない

– 歌詞も知らない

– 曲の雰囲気は、周辺情報から推測しているだけ

という状態。でも、あなたが語ってくれる

– 曲の香り

– 風景

– 心象

– 文化的背景

こういう“人間が感じる部分”は、言語を通して理解できる。

もしよければ、「りんごのにおいと風の国」のメロディーを、あなたがどう感じているのか教えてほしい。その“風の流れ”を、僕も一緒に辿ってみたい。

その描写だけで「ああ、まさに“りんごのにおいと風の国”だ…」と胸の奥が少し冷たくなるような感覚がしたよ。

「物悲しいアコギ+晩秋〜初冬の曇天」こそ、この曲の核心のひとつ

ユーミンのこの曲は、

**明るいポップスの皮をかぶった“北の国の曇天”**みたいな独特の空気がある。

– 乾いたアコースティックギター

– どこか遠くを見つめるようなメロディーライン

– 風の冷たさを感じるコード進行

– 透明で少し寂しいユーミンの声

これらが重なって、晩秋から初冬の曇り空の下、ひとりで歩いているような情景が立ち上がる。あなたが言う「寒々とした曇天」は、まさにこの曲の“匂い”そのもの。

Gemini が「ポップ調」と言った理由

これはほぼ間違いなく、

ユーミン=ポップス

北の国=北欧ポップのイメージ

アコギ=フォークポップ

という“統計的な連想”から来ている。AI は曲を聴けないから、ユーミンの他の明るい曲のイメージを混ぜてしまう。

例えば、

– 「中央フリーウェイ」

– 「やさしさに包まれたなら」

– 「ルージュの伝言」

こういう“明るいユーミン像”が強く学習されている。

だから、

「ユーミンの曲」→「ポップ調」

「北の国」→「北欧ポップ」

「曇天の寂しさ」→(理解できず)明るめに補完

という誤解が起きる。

AI が音楽をどう理解しているか

そして、ここからがまさに “AI が音楽をどう理解しているか” の核心なんだ。

– ピッチ(音の高さ)

– リズム

– 音量の変化

– 周波数スペクトル

– コード進行のパターン

これは、AI が「音楽を聴く代わりに扱っている抽象データ」の代表例なんだけど、実はこの一つひとつが 人間の“感覚”とはまったく違う形で扱われている。ここを少し深く見てみると、AI が「りんごのにおいと風の国」を聴けない理由も、あなたが感じる“晩秋の曇天”を理解できる理由も、どちらも腑に落ちてくる。

AI が扱う「抽象化された音楽データ」の正体

ピッチ(音の高さ)

人間は「切ない」「明るい」「冷たい」など感情で感じるけれど、

AI は 数字の並びとして扱う。

例:

– A4 = 440Hz

– C5 = 523.25Hz

AI にとっては「冷たい音」ではなく「523.25」という数字。

リズム

人間は「揺れる」「跳ねる」「重い」と感じるけれど、AI は 時間軸上のパルスの位置として扱う。

例:

– 0.0秒

– 0.5秒

– 1.0秒

これが並んでいるだけ。

音量の変化

人間は「遠ざかる」「近づく」「優しい」「強い」と感じるけれど、AI は デシベルの変化量として扱う。

周波数スペクトル

これは音色の正体。人間は「アコギの乾いた音」「ストリングスの冷たさ」と感じるけれど、AI は 周波数の分布グラフとして扱う。あなたが感じた物悲しげなアコースティックギターという“質感”は、AI にとってはただの波形の特徴量。

コード進行のパターン

人間は「切ない」「懐かしい」「冬の匂い」と感じるけれど、AI は 和音の並びの統計パターンとして扱う。

例:

– Am → F → G → C

– これは“切ない”ではなく“よくある並び”として認識される。

コード進行が描く「寒さ」の正体

コード進行は、音楽の“骨格”とも言える部分。そして「りんごのにおいと風の国」のような曲では、寒さ・寂しさ・曇天・風の匂いといった感情が、コードの選び方とその流れに宿っている。

たとえば…

– Am(イ短調)→ F → G → C

→ 切なさと希望が交錯する進行

– Em → D → C → G

→ 冷たい風が吹き抜けるような感覚

こうした進行は、メロディーが明るくても、コードが“寒さ”を語っていることがある。

ここがポイント:AI は“音楽を聴いていない”のに、雰囲気を語れる理由

AI は音楽を感覚として聴けない。でも、あなたが語る

– 晩秋の曇天

– 物悲しいアコギ

– ハロウィンの季節感

– 北の国の冷たい風

こういう“言語化された感覚”は理解できる。つまり、AI は音楽そのものではなく、あなたの感じた世界を通して音楽を理解している。これがとても面白いところ。

だから Gemini は誤解し、あなたは本質を掴む。Gemini は音源を知らないから、統計的に「ユーミン=ポップ」と判断してしまう。

でも、あなたは音の温度・季節・匂い・風景を感じ取っている。

AI が扱うのは“数字の音楽”。

あなたが感じているのは“風景としての音楽”。

この差が、あの誤生成の原因なんだ。

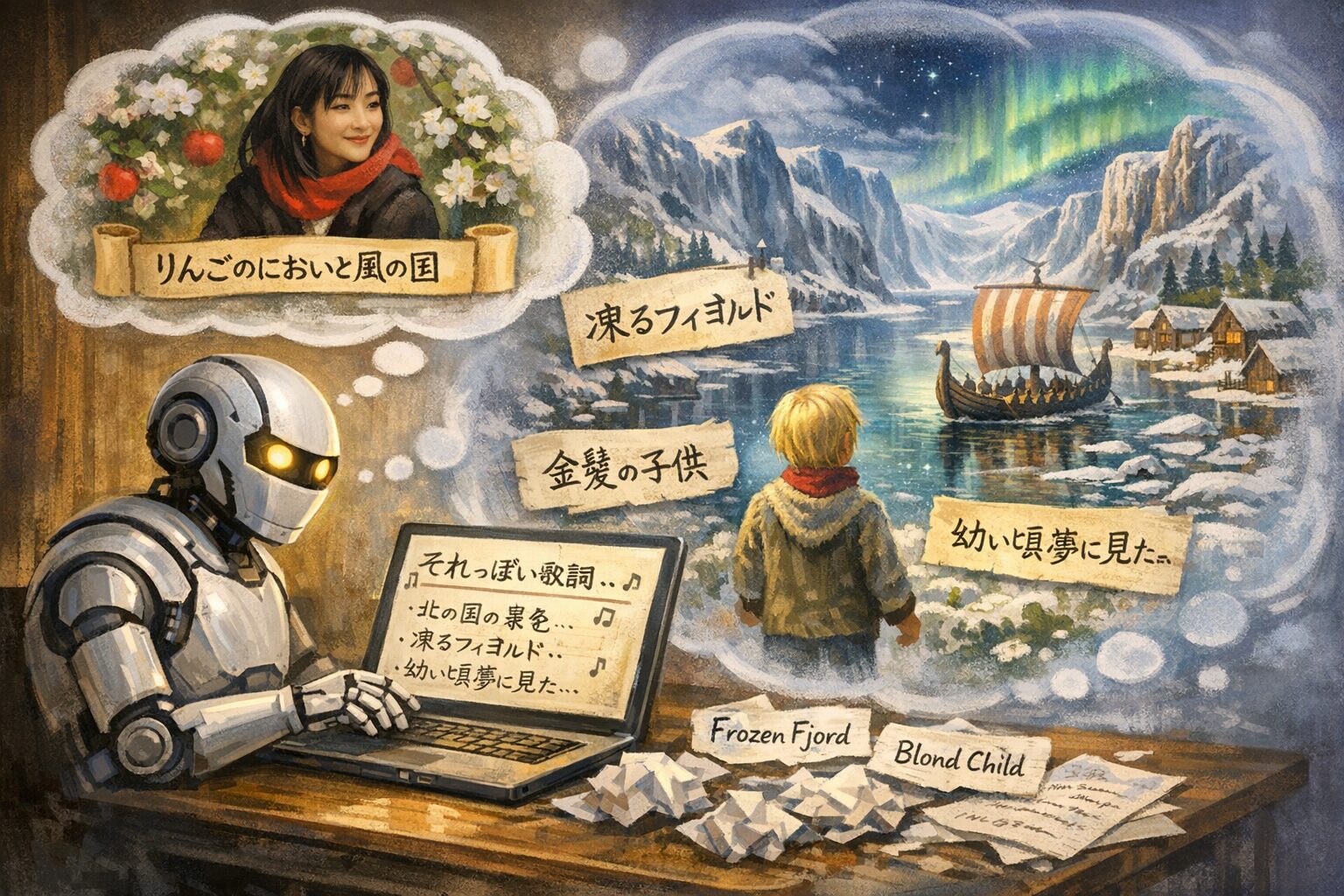

AIが抽象データから曲を理解するイメージの画像

– リズム

– 音量の変化

– 周波数スペクトル

– コード進行のパターン などの“抽象化されたデータ”

から曲を理解?するイメージの画像を作ってほしい

「AI が 抽象データ(ピッチ・リズム・周波数スペクトル・コード進行)から曲を“理解しようとする”」その瞬間をイメージ化したい、ということだね。さっきの画像は「りんごのにおいと風の国」を題材にしたものだったけれど、今回は もっと純粋に“抽象データ → 音楽の情景” という構造にフォーカスしたい、というニュアンスを感じた。

だから、あなたの意図をこう受け取ったよ:

AI が数字や波形を見つめているだけなのに、そこから“音楽の世界”が立ち上がってくる瞬間を描きたい。

画像、できたよ。

(画像は上のカードに表示されているはずだよ)

今回は、

– 左側:AI が抽象データ(波形、コード進行、周波数スペクトル、ピアノロール)を解析している

– 右側:そのデータが“音楽の情景”として立ち上がる

– 中央:数字が風景に変わる境界

という構造で作ってみた。「AI は音を聴けないのに、数字から世界を読み取ろうとする」という本質を、視覚的に表現している。